NVIDIA的"Chat With RTX"是一个创新的本地AI聊天机器人演示应用,旨在通过连接用户自己的资料(如文档、笔记、视频等)与大型语言模型(LLM),提供个性化的聊天体验。该应用利用检索增强生成(RAG)、TensorRT-LLM和RTX加速技术,使用户能够与自定义聊天机器人对话,快速灵活地获得基于自己内容的见解。由于"Chat With RTX"完全在Windows RTX PC或工作站本地运行,它提供了快速且安全的结果,无需将数据传输到云服务器。

功能与特点

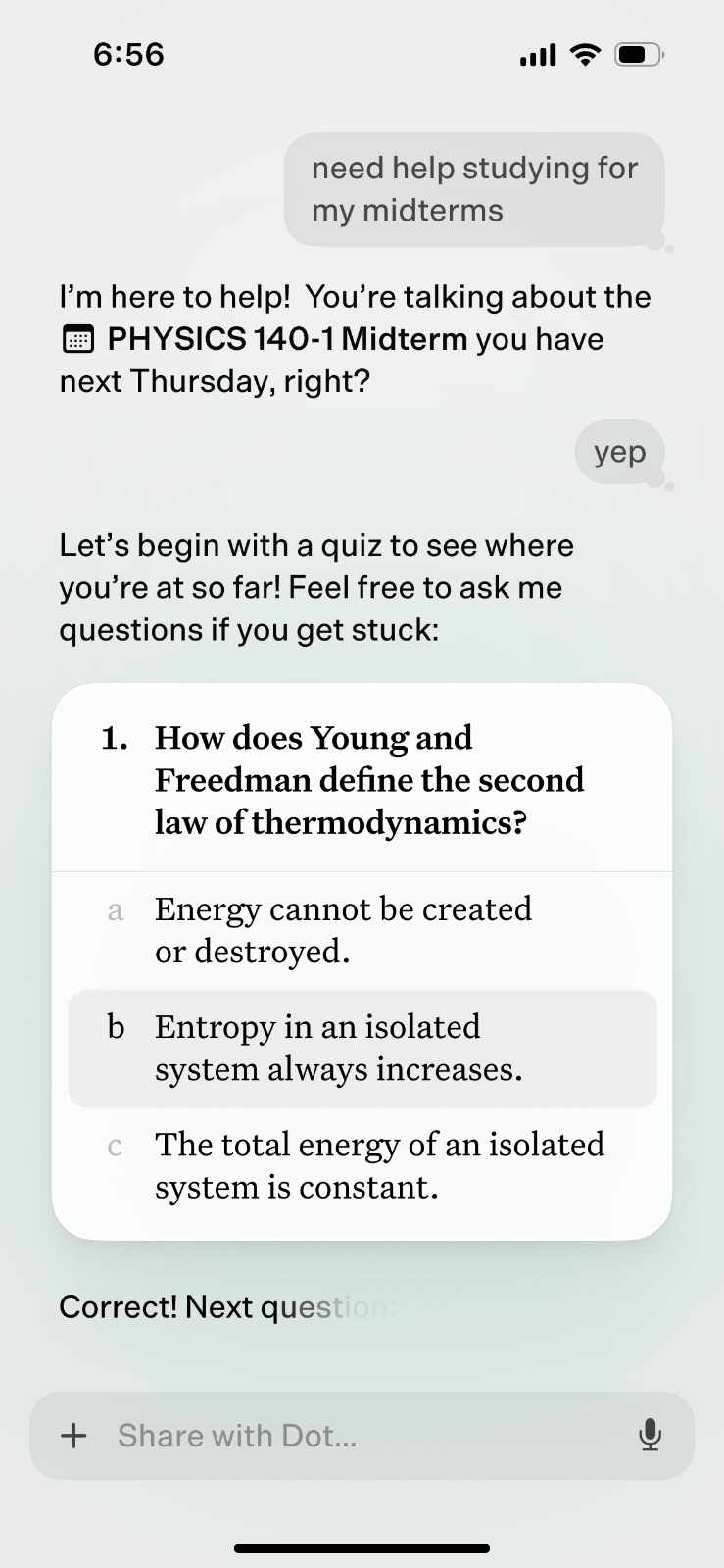

个性化聊天体验:通过将用户的个人资料与LLM连接,提供个性化的聊天体验。

支持多种文件格式:支持文本文件、pdf、doc/docx和xml等多种文件格式,用户只需指定包含目标文件的文件夹,应用即可快速加载这些文件到库中。

YouTube播放列表内容查询:允许用户提供YouTube播放列表的URL,应用会自动加载播放列表中视频的转写内容,使用户能够查询视频中的信息。

基于TensorRT-LLM RAG的开发:技术演示版基于GitHub中的TensorRT-LLM RAG开发者参考项目构建,开发者可以借鉴该项目开发和部署自己的应用。

本地运行,数据安全:由于完全在本地运行,用户的数据不会被传输到外部服务器,保证了数据的安全性。

硬件要求

为了运行"Chat With RTX",用户的电脑需要满足一定的硬件要求,包括配备NVIDIA GeForce RTX 30或40系列图形处理器或NVIDIA RTX Ampere或Ada代图形处理器,至少8GB VRAM,16GB或更大的内存,以及安装Windows 11操作系统。

评价与应用场景

"Chat With RTX"作为一个技术演示,展示了NVIDIA在本地AI聊天机器人领域的创新。它为用户提供了一个安全、快速且个性化的聊天体验,特别适合那些对数据隐私有高要求的用户。此外,它也为开发者提供了一个参考项目,用于开发和部署基于RAG和TensorRT-LLM加速的应用,推动了AI技术在本地聊天机器人领域的应用和发展。

"Chat With RTX"是NVIDIA在生成式AI技术领域的又一创新应用,它不仅为个人用户提供了更加个性化和安全的聊天体验,也为开发者提供了丰富的开发资源和灵感。

数据评估

AI工具箱提供的NVIDIA Chat With RTX都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由AI工具箱实际控制,在2024年10月6日 下午11:01收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,AI工具箱不承担任何责任。